Столкнулся с данной проблемой у одной из запущенных VM под управлением VMware ESXi, 7.0.3, 20328353.

Симптомы:

1. VM запущена и работает. Жалоб от пользователей не поступает;

2. При попытке выполнить vMotion появлется ошибка:

The object or item referred to could not be found.3. Далее в hostd.log можно увидеть записи следующего характера:

Failed to find file size for /vmfs/volumes/.../VM_NAME.nvram: No such file or directory4. В vCenter UI статус виртуальной машины отображает следующее:

Some of the disks of the virtual machine VM_NAME failed to load. The information present for them in the virtual machine configuration may be incomple5. На уровне хранения нет никаких проблем. Все файлы виртуальной машины находятся на datastore;

6. С другими виртуальными машинами на том же хосте\хранилище проблем нет;

7. Рекоммендации по типу “Rescan Datastore” не работают.

Решение.

Прежде, чем продолжить, убедитесь что есть резервная копия.

В моем случае решение было достаточно простым, но потребовало остановки VM:

- Останавливаем виртуальную машину;

- После этого VM будет отображаться как inaccessible;

- Удаляем машину из vCenter inventory;

- Переходим в datastore, находим виртуальную машину и файл vmx;

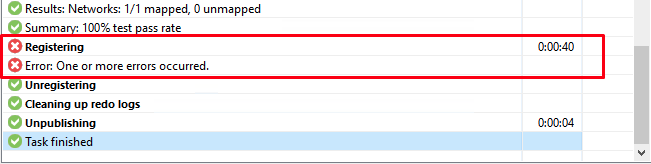

- Выделяем файл, клик по Register VM;

- После того, как машина вновь появилась в Inventory, включаем.

После включения машины никаких дальнейших проблем возникнуть не должно.

![]()